学院概况

About-

-

新闻公告

News -

师资队伍

Faculty -

科学研究

Research -

教学工作

Teaching -

学生事务

Student -

学院招生

Admission -

招聘信息

Careers

学院概况

About新闻公告

News师资队伍

Faculty科学研究

Research教学工作

Teaching学生事务

Student学院招生

Admission招聘信息

Careers汪天富教授团队岳广辉副教授组聚焦于人工智能、医学图像分析相关研究,近日在IEEE TMI、IEEE TIM、IEEE TASE等国际顶级杂志上发表系列成果。

一、内窥镜视频质量评价

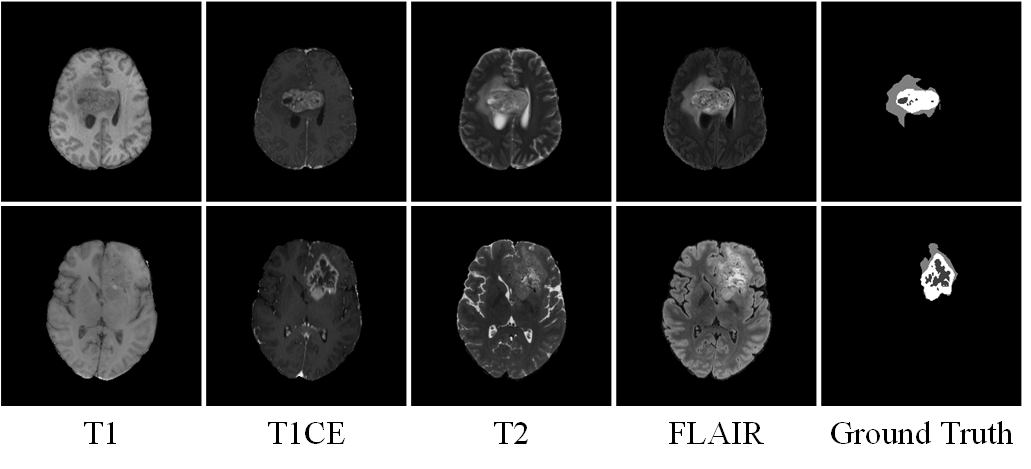

结直肠癌是全球第三大致命癌症,严重威胁公共健康。结肠镜检查通过直接观察并切除早期病变,是预防肿瘤恶化的关键手段。然而,由于成像环境的复杂性,结肠镜视频常受到运动模糊、亮度低、异常曝光等多种失真的影响,增加了漏诊和误诊风险。因此,亟需设计有效、可靠的视频质量评估(VQA)指标,为医生提供定量的质量反馈,以便及时调整操作,提高视频质量,确保诊断的准确性。现有的VQA方法多用于自然场景,主要针对压缩、模糊、曝光等失真,无法满足结肠镜视频的特殊需求。为此,本研究构建了首个多属性视觉感知标注的结肠镜视频质量评估数据集——MAC-VQA。该数据集包含1000个具有真实失真的结肠镜视频,从五个失真属性(时空可视性、亮度、镜面反射、稳定性和实用性)及整体质量角度进行感知质量标注,为结肠镜视频质量评估的深入研究提供了重要的基础支持。

图1 MAC-VQA数据集的样例

针对不同失真属性之间的相互影响及其对整体质量影响存在较大差异的问题,本研究提出了一种创新的无参考视频质量评价方法——DARNet。该网络能够自适应地聚合属性感知特征,预测各失真属性的质量分数,并结合主观评分行为推理整体质量分数。如图2所示,DARNet的网络框架由时空特征提取(STFE)单元和特征交互与推理(FIR)单元组成。STFE单元包含两个用于提取空间和时间质量失真特征的流,而FIR单元则由多属性关联(MAA)模块和行为引导推理(BGR)模块构成。MAA模块能够自适应地聚合提取的特征,并预测每个失真属性的质量分数;BGR模块则根据被试对失真属性相关性的反馈,在属性感知特征之间进行交互推理,从而得出整体质量分数。

图2 DARNet的网络框架

以上成果“Subjective and Objective Quality Assessment of Colonoscopy Videos” 发表在顶级期刊IEEE Transactions on Medical Imaging(TOP期刊, 中科院一区,IF=8.9)上。岳广辉副教授为第一作者,研究生张俪馨为第二作者,深圳大学为第一作者单位和通讯单位。

原文链接:

https://ieeexplore.ieee.org/abstract/document/10681143

二、脑肿瘤分割

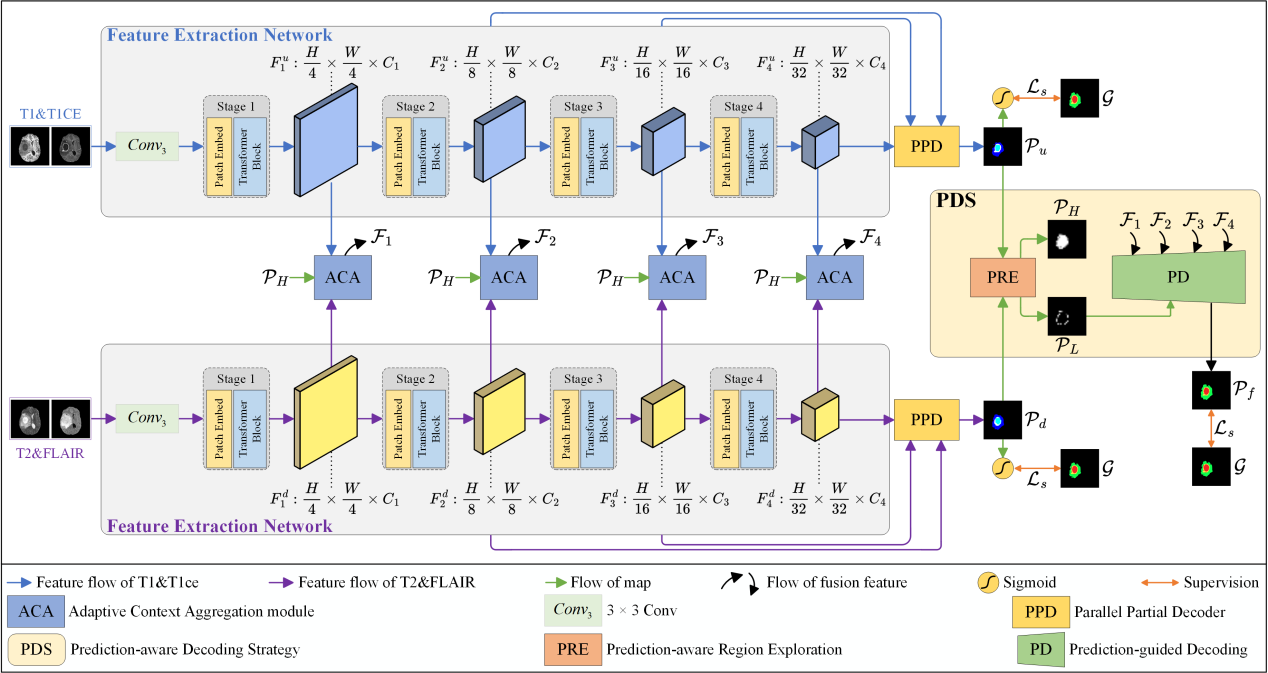

脑肿瘤是一种高度侵袭性和恶性的神经系统肿瘤,对患者的身心健康构成严重威胁。由于其复杂性,通常在晚期才被发现,从而使临床治疗变得极为困难。因此,早期诊断脑肿瘤至关重要。在临床上,磁共振成像(MRI)是检测和诊断脑肿瘤的首选手段。MRI包括四种成像方式:液体衰减反转恢复(FLAIR)、T2加权(T2)、T1加权(T1)和T1增强(T1CE),提供了关于脑组织结构和病变的不同信息。通过MRI对脑肿瘤进行分割,可以帮助放射科医生更准确地识别和定位肿瘤组织,从而更好地规划手术和监测治疗。然而,放射科医生在MRI上进行脑肿瘤分割是一项费力且主观的任务,常常导致注释的不确定性。因此,亟需设计有效、可靠的脑肿瘤自动分割(BraTS)方法,以减轻放射科医生的工作负担并提高分割准确率。

图3 MRI四种成像方式以及脑肿瘤分割的样例

现有的BraTS方法在处理MRI多模态数据时往往只考虑图像级别或编码器后期的多模态数据融合,忽略了编码器中多阶特征之间的相互作用。此外,大多数方法在融合各层次特征时常常忽略不同模态之间的差距,这可能掩盖了模态间的判别信息。由于MRI中肿瘤与非肿瘤区域的对比度较低,许多方法在边界区域产生了分割不确定性。为了解决多模态多阶特征融合和边界不确定性的问题,本研究提出了一种创新的脑肿瘤自动分割方法—ACANet。如图4所示,ACANet由双分支组成,其中根据模态的关联性,我们将FLAIR和T2作为一对,T1和T1CE作为另一对,分别输入网络的两个分支。ACANet主要由特征提取网络、自适应上下文聚合(ACA)模块和预测感知解码策略(PDS)三个部分组成。特征提取网络用于提取鲁棒且语义信息丰富的特征;ACA模块旨在自适应地融合多模态特征,以弥合不同模态之间的差距,从而提高肿瘤感知特征的表示能力;PDS则自适应地探索两个分支得到的预测来获取边界线索,并利用边界线索指导解码阶段实现准确分割。通过所提出的ACA模块与PDS的有效结合,我们的ACANet能够有效地分割脑肿瘤。

图4 ACANet的网络框架

以上成果“Adaptive Context Aggregation Network With Prediction-Aware Decoding for Multimodal Brain Tumor Segmentation”发表在顶级期刊IEEE Transactions on Instrumentation and Measurement(TOP期刊, 中科院二区,IF=5.6)上。岳广辉副教授为第一作者,研究生吴尚杰为第二作者,深圳大学为第一作者单位和通讯单位。

原文链接:

https://ieeexplore.ieee.org/document/10582891

三、结直肠息肉分割

(1)基于双域特征融合的息肉分割算法

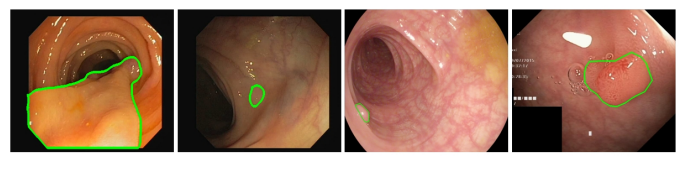

结肠直肠癌是全球发病率最高的癌症之一,也是导致癌症死亡的主要原因之一。结直肠癌通常起源于结肠或直肠内的腺瘤性息肉,并在数年内逐步形成。研究发现,早期发现和切除息肉对预防结肠直肠癌至关重要。因此,开发具有计算机辅助手术系统的自动手术机器人变得非常重要。结肠镜检查广泛用于结直肠癌筛查,能够提供息肉的位置和外观信息。息肉分割作为一项重要的任务,可以为计算机辅助手术系统提供息肉位置。然而,由于息肉外观多样且背景复杂,在结肠镜图像中准确分割息肉具有挑战性。因此,设计一种更鲁棒的息肉分割方法是迫切的。

图5 息肉结肠镜检查图像示例

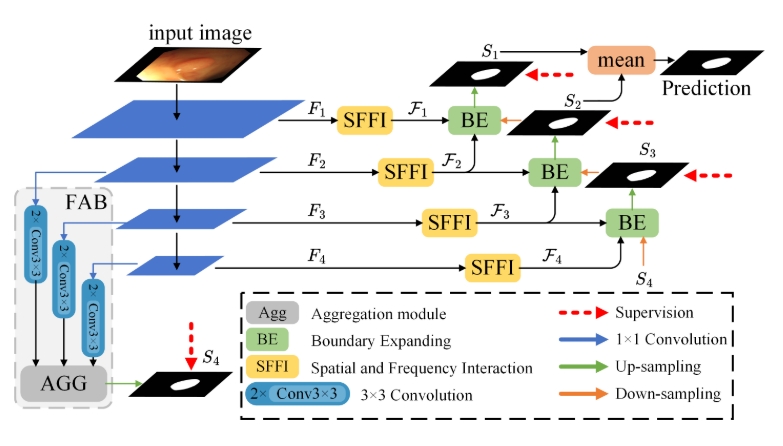

目前,大多数分割方法在处理形状不规则、边界模糊的息肉时表现不佳。为此,本研究提出了一种新的息肉分割网络—DFINet。如图6所示,DFINet中主要由两个模块组成:空间和频率特征交互(SFFI)模块和边界增强(BE)模块。SFFI模块通过提取空间和频率特征来帮助网络应对息肉的不规则形状;BE模块旨在聚合跨层特征,自适应地挖掘边界线索,从而增强网络对边界区域的表征能力。通过自上而下连接BE模块,DFINet能够对息肉区域进行由粗到细的定位,最终得到准确的分割结果。

图6 DFINet的网络框架

以上成果“Dual-Domain Feature Interaction Network for Automatic Colorectal Polyp Segmentation”发表在顶级期刊IEEE Transactions on Instrumentation and Measurement(TOP期刊, 中科院二区,IF=5.6)上。岳广辉副教授为第一作者,本科生李苑妍为第二作者,深圳大学为第一作者单位。

原文链接:

https://ieeexplore.ieee.org/document/10700796

(2)基于渐进式边界感知的息肉分割算法

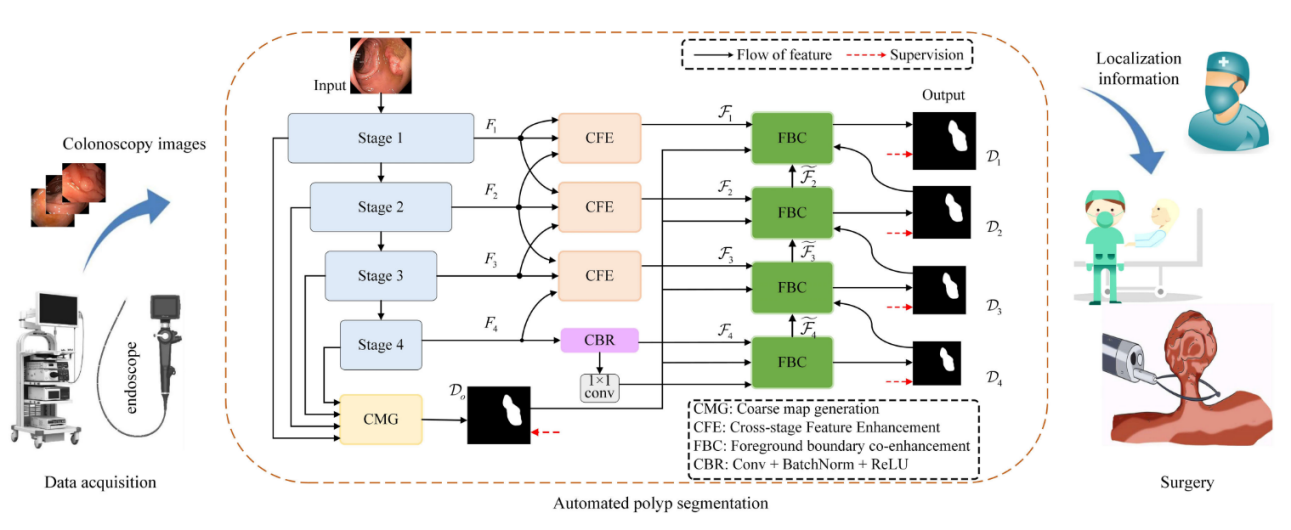

现有的方法虽然能够取得良好的定位效果,但由于在全局上下文建模和跨层特征交互方面的局限性,在复杂背景、形状/大小变化、边界模糊的息肉定位中往往遇到困难。为了应对这些问题,本文提出了一种新的息肉分割方法—PFENet,框架如图7所示。具体而言,PFENet遵循编码器-解码器结构,并利用金字塔视觉Transformer作为编码器来捕获多尺度特征。为了识别背景复杂、形状/大小多变的息肉,PFENet在网络的每一层引入了跨阶段特征增强(CFE)模块,通过相邻阶段之间的特征交互整合不同尺度的信息。此外,针对模糊边界的挑战,PFENet在解码器中设计了前景-边界协同增强(FBC)模块,能够自适应地提取边界信息,并与相邻高层的前景输出协同增强前景和边界信息。通过自上而下连接FBC模块,PFENet能够以由粗到细的方式逐步细化预测,从而实现准确的息肉分割结果。

图7 PFENet的网络框架

以上成果“Progressive Feature Enhancement Network for Automated Colorectal Polyp Segmentation”发表在顶级期刊IEEE Transactions on Automation Science and Engineering(TOP期刊, 中科院二区,IF=5.9)上。岳广辉副教授为第一作者,研究生肖厚禄为第二作者,深圳大学为第一作者单位和通讯单位。原文链接:https://ieeexplore.ieee.org/document/10616032

上述研究依托于广东省生物医学信息检测与超声成像重点实验室和医学超声关键技术国家地方联合工程实验室开展,并得到了国家自然科学基金、广东省自然科学基金、深圳市自然科学基金、深圳大学医工交叉基金等项目的资助。